Дипфейк: визуалды вирус немесе digital алаяқтықтың жаңа деңгейі

Цифрлық технологиялардың дамуы адамзат өмірін жеңілдетіп қана қоймай, жаңа этикалық, құқықтық және қауіпсіздік мәселелерін тудырып отыр. Соның бірі – дипфейк технологиясы. Бұл технология жасанды интеллект көмегімен адамның бейнесі мен дауысын шынайы түрде өзгертіп, жалған видео немесе аудио контент жасауға мүмкіндік береді. Бастапқыда бұл жаңалық баршамыздың қызығушылығымызды тудырғаны рас, алайда бүгін қоғамның алаңдаушылығына айналды. Өйткені бұл құрал шындық пен жалғанның шекарасын бұлдырата бастады.

Термин туралы толығырақ

Тақырыпқа тереңдемес бұрын, терминнің тарихы қайдан шыққанын біліп алғанымыз дұрыс болар. Тамырына бойласақ, бұл ұғымның ғаламторда пайда болғанына біразға жуықтаған. Нақтырақ айтсақ, бұны 2014 жылы жасанды интеллект жасаушыларға арналған Стэнфорд университетінің студенті Ян Гудфеллоу есімді азамат ойлап тапқан.Ал терминнің мағынасына келсек, ағылшын тілінен аударғанда learning – «терең оқыту» және fake – «жалған») – жасанды интеллект арқылы аудио және видеоматериалдарды шынайы манипуляциялау дегенді білдіреді. Қысқаша айтқанда, бұл технология адамның бет-әлпетін, мимикасын, дауысын шынайы етіп басқа біреудің денесіне «жапсырып», бейнежазба жасайды. Әдетте GAN (Generative Adversarial Networks) атты нейрожелі үлгілері қолданылады.

Бастапқыда біз білетін дипфейк ұғымының қолдану тар болды. Кейін сәулеттен бастап журналистикаға дейін көпшілікке арналған мәдениетте қолданыла бастады.Кей деректерге сүйенсек, жалпы бұл құралды қолдану сонау тоқсаныншы жылдарда бастау алғанын аңғарамыз. Сол уақытта киноиндустрияда кейбір эффектілер осы дипфейктің көмегімен актерлерді жасарту, қайтыс болған тұлғаларды экранда «қайта тірілту» сынды дүниелерді жасаған деседі. Кейін дипфейк жасауға арналған арнайы бағдарламалар жасақталып, жұмыстар одан әрі жетілдіріліп, жеңілдей түскен. Жаһан жанданып, заман алға жылжыған сайын жасанды интеллектінің игіліктерін көріп жатырмыз. Әйтсе барлығын жемісті деп айта алмаймыз. Өйткенікейбір технологиялар теріс мақсатта қолдануда.

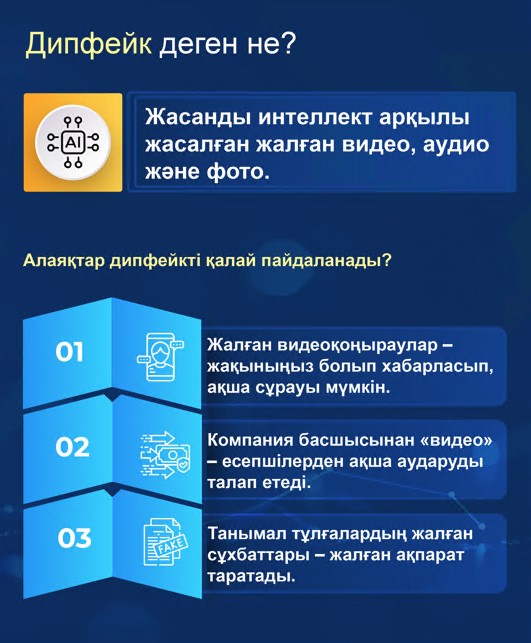

Алаяқтардың жаңа айласы

Адамдарды алдап, құрығына түсіруден қорықпайтындар заман көшінен қалысар емес. Оңай олжаға дәмесі барлар түрлі қулыққа барып, көпшілікті ойланбастан сан соқтырып жүр. Яғни, кейбіреу үшін тың саналатын технологияны қолданып, оны кәдесіне жаратуда. Жасанды интеллекттің көмегімен адамдарға «жан бітіріп», кейбір адамның бет-әлпетін өзіне жапсырып, сөздеріне имандай сендіреді. Өйткені олар әрбір әрекетті, нақтырақ айтқанда, кез-келген дауысты, ым-ишараны айнытпай салады. Сондықтан олардың сөздеріне илану оп-оңай. Шыны керек, әлемде осындай оқиғалар соңғы уақытта жиі орын алуда. Мысалы, әлемдік әнші Тайлор Свитстің басында болған жағдайға байланысты АҚШ пен Еуро Одақ дипфейк порнографиясына қарсы заң жобасын талқылауға түрткі болды. Себебі әншінің жасанды интеллектпен жасалған интимдік суреттері желіде желдей есіп, 4chan және X платформаларында таралып кетті. Тіпті қаралым саны 47 миллионнан асқан. Бұл оқиға кәдімгідей резонанс тудырды. Дипфейкке қатысты тағы бір оқиғаға мысал келтірсек, бір әйелөзін актер Оуэн Уилсон деп таныстырған дипфейк видеоға сеніп, алаяқтың арбауына түседі. Бұл оқиға дипфейк технологиясының жеке адамдарға қалай зиян келтіретінін көрсетті.Тағы сол сияқты 2022 жылы Украина президенті Зеленскийдің әскерге қаруды тастауға шақырған дипфейк видеосы тарады. Кейін бұл саяси манипуляцияға негізделген дипфейк видео деп танылды.

Соңғы уақытта ютубте жиі алдыңнан шыға келетін жарнамалардың көбі –осы дипфейк видеолар. Сондай технологиямен жасалған бір видеоны мысалға келтірсем. Тележурналист Дана Нұржігіттің осыдан біраз уақыт бұрын әнші Димаш Құдайбергенмен өрбіген сұхбаты қазір басқаша бұрмаланғанын байқадым. Бір қараған адамға мұның дипфейк екенін аңғару әрине қиын. Бірақ бұл сұхбатты бұрын соңды көрген адам анализ жасаса, мұның жалған екенін анық біледі. Көпшілікке түсінікті болу үшін бұл дипфейк қандай контекске негіделгенін қысқаша айтып өтейін. Біз жиі ұшырасып жүрген жарнамалық видео Дана НұржігіттіңДимаш Құдайбергенге «маңызды ақпаратыңмен бөліскің келгенін білеміз» деп сөз беруімен басталады. Жасанды интеллект арқылы жасалған дүниеге сеніп те қалуыңыз мүмкін. Өйткені өте сапалы жасалғаны көрінеді. Аталған тұлғалардың бет-әлпеті, даусы, мимикасы тұп-тура солардікіндей. Дегенмен бұл – дипфейк. Өйткені жарнама астында Дана Нұржігіттің өзі растап, «Абайлаңыздар, deep fake! Жасанды интеллект Димаш екеумізді де фейк жарнамаға қосыпты! Сенбеңіздер!» – деп жазған жазбасы бар.

Қауіппен күрес қалай?

Жоғарыдағыдай жағдай біздің елде де кең көрініс тауып жатыр. Соңғы уақытта «уатсап» әлеуметтік желісі арқылы қоңырау шалып, өзін мемлекеттік орган қызметкері немесе құқық қорғау, банк өкілімін деп таныстырып, дипфейкті өз пайдасына асырып жүргендер жетерлік.

Жыл басынан бері Қазақстанда жалған ақпарат тарату бойынша 34 қылмыстық іс қозғалған. Оның тек үшеуі әйелдерге қатысты. Интернет-ресурстарды заңсыз пайдалану туралы бір іс тіркелген. Жылдың бастапқы айларында 246 заңсыз жарияланым анықталып, оның 232-сі әлеуметтік желілерде тараған.

Елдегі заңға сәйкес, «Анализ және ақпарат орталығы» онлайн кеңістікті мониторинг жүргізіп, заңсыздықтарды уәкілетті органдарға жедел жеткізеді. Заңсыздық анықталған жағдайда платформа иелеріне фейк контентті жою туралы хабарламалар жіберіледі. Құқық бұзушылықтар туралы мәліметтер ІІМ-ге беріледі. Министрлік ірі платформалармен өзара байланыс үшін арнайы механизмдер әзірледі, мысалы, Facebook автоматтандырылған жүйе арқылы хабарламалар алады, ал YouTube үшін ресми хаттар дайындалады. Өкінішітісі, кейбір жағдайлар уақытында зерделенбей, құзырлы мекеменің қарауына жіберілмей қалып қойып жатыр. Өйткені көбімізге сауаттылық жетіспейді. Көргенімізге оңай сене саламыз. Сана мен шындық арасындағы шекараны жоюға құлықсызбыз...

Қалай қорғанамыз?

Елімізде де, әлемде де дипфейктің құрбаны болып жатқандар көп. Әрине, бәрі сақтанбаудың салдарынан. Қала берді ақпараттық сауаттың аздығы да алаяқтарға алдануға себеп болып тұрғанын да айтпаса болмайды. IT, жасанды интеллектбойынша білімін жетілдіріп жүрген Думан Кеңесов есімді жас «дипфейктен толық қорғану мүмкін болмағанымен,ақпаратты сүзгіден өткізу, жеке мәліметтерді қорғау және заңдық-қоғамдық бақылауды күшейту арқылы өзімізді және қоғамды қорғауға болады» дейді.

– Әрине, ол үшін әрқайсымыз цифрлық иммунитетті қалыптасыруымыз қажет. Әр азамат көрген контентке сыни көзбен қарауға, ақпаратты тексеруге машықтануы тиіс,–дейді Думан Әміржанұлы.

Ал Нұргелді есімді мұғалім медиасауаттылықты арттыру бәрінен маңызды деп есептейді. Яғни, мектептер мен ЖОО-ларда ақпараттық қауіпсіздік және дипфейк туралы арнайы сабақтар енгізіп, дипфейкті анықтайтын жүйелер кеңінен қолдану керек дейді ол.

Сонда ғана қоғамда ақпаратты дұрыс талдап барып, қабылдауға деген түсінік қалыптаспақ» дейді.

Қандай жауапкершілік жүктейді?

Үстіміздегі жылдың 5 наурызында Мәжілісте жасанды интеллект туралы жаңа заң жобасы аясында дипфейктерді құру әрекеттері үшін қылмыстық жауапкершілік жазасы енгізу туралы мәселе талқыға түскенін білеміз. Заң жобасын таныстырған Елена Смышляева адамдарды әлеуметтік, биометриялық және мінез-құлық ерекшеліктеріне қарай бағалау үшін ЖИ қолдануға қатаң шектеу енгізілетінін, сондай-ақ адам мінез-құлқын манипуляциялай алатын ЖИ құруға және пайдалануға тыйым салынатынын айтты. Яғни, дипфейк үшін заң аясында әкімшілік жауапкершілік көзделмек. Айыппұл мөлшері 15-тен 100 АЕК-ке дейін болады (2025 жылғы есеп бойынша – 58 980 теңгеден 393 200 теңгеге дейін). Мәжіліс депутаттары қылмыстық жауапкершілік бойынша нақты шешім қабылдаған жоқ, өйткені бап мазмұны алдағы уақытта тағы талқыланбақ.

Депутаттың айтуынша, дипфейктер қоғам пікіріне әсер етіп, адамдарды адастыруы мүмкін. Сондықтан мұндай технологияларды қолдануға тыйым енгізіледі. Әсіресе бұқараға танымал адамдар жиі зардап шегеді, өйткені олардың жеке деректері келісімсіз пайдаланылады.

«Бұл тыйымды біз заң жобасында ескердік. Әзірге дипфейктерді жасауға мүмкіндік беретін жүйелердің иесіне қатысты жауапкершілік енгізіліп отыр. Айыппұл көлемі 15-тен 100 АЕК-ке дейін белгіленбек. Бұл бизнес субъектісіне байланысты болады», – деді депутат.

Қауіпсіздік қағидаларын ескеріңіз

Жасанды интеллекті қарқынды дамып, күш алып жатқанын ескерсек, кибералаяқтардың күн сайын ойлап шығаратын технологияларының көмегімен тіпті инновациялық және цифрлық технологияның дәуірімен бірге жасап келе жатқан жасампаз ұрпақты да алдау түк емес сияқты көрінеді. Әрине, бұл біздің іштегі болжам. Бәлкім қауіпсіздік қағидаларын қатаң ұстансақ, бұның бірі де болмас.

Олай болса, бірқатар ескертпелерді ескеріңіз дегім келеді. Егер сізге дипфейк технологиясы арқылы байланысқа шықса, шынайы адамның шыққанын ажырату үшін оған бірнеше сұрақтар қоюға тырысыңыз. Сондай-ақ әуелі оның мимикасына, қасы мен көзіне назар аударыңыз. Айналасында көлеңке түсіп тұрғандығына мән беріңіз. Өйткені дипфейк табиғи жарықты көп жағдайда дәл көрсете алмайды.

Егер қоңырау шалған адам сіздің аты-жөніңізді, тұрғылықты мекенжайыңызды білсе, бұлар ресми тұлға болуы мүмкін дегенді естен шығарыңыз. Өйткені қазір интернет желісінен кей деректі алу көпшілікке қол жетімді.

Өзіңізге хабарласқан адамның толық аты-жөні мен лауазымын тәптіштеп тұрып сұраңыз және кері байланыс құрыңыз. Егер жақыныңызды желеу етіп, қоңырау шалса немесе қиын жағдай түстім деп ақша аударуды сұраса, нақтыламай жатып бірден әрекетке көшпеңіз. Сонымен бірге қандай жағдай болса да дербес дерегіңізді ешкімге бермеңіз. Әсіресе, ЖСН, банк шоты, құпиясөздер мен SMS арқылы келетін кодтарды ешкімге бермеңіз.Абзалы, ақпаратты тек ресми және расталған дереккөздерден алыңыз.

Түйін: Дипфейк – бұл жай ғана әзіл немесе технологиялық жетістік емес, сананы улайтын визуалды вирус. Ол шындық пен жалғанның ара жігін жойып, адамның сеніміне шабуыл жасайды. Сондықтан оны ерте анықтап, оған қарсы тұру –әрбір саналы адамның міндеті.

Арайлым ҚУАНТҚАНҚЫЗЫ