Жасанды интеллект: қауқар мен қауіп

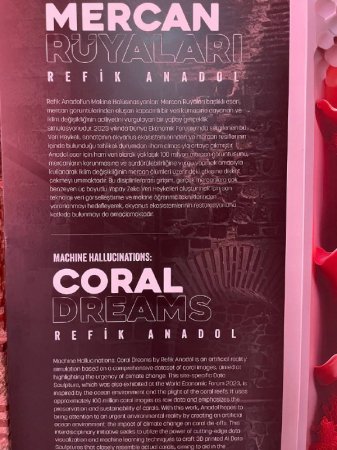

Фото: hashtelegraph.com

Фото: hashtelegraph.comБүгінгідей заманауи технологияның күн өткен сайын қарқынды дамуы соншалық адамның өмір сүру жағдайын жақсартуда түрлі жаңалықтармен таңқалдыруда. Соның ең бір ерекшесі – Жасанды интеллект (ЖИ). Жасанды интеллект (ағылшынша artificial intelligence, AI) – интеллектуалды компьютерлік бағдарламалар мен машиналар жасау технологиясы әрі ғылым.

ЖИ технологиясының қарқынды дамуы адамзаттың болашағына айтарлықтай әсер ететіні сөзсіз. Бір жағынан, ЖИ білім, денсаулық сақтау, экономика және қоршаған ортаны қорғау салаларында бұрын-соңды болмаған мүмкіндіктер ашады. Екінші жағынан, оның дамуымен бірге елеулі қауіп-қатерлер де туындайды. ЖИ-дің адамзатқа төндіретін негізгі қауіптері және оларды басқару жолдары қандай? Қарастырамыз.

AI деген не?

Адам баласының бүгінгі онлайн және оффлайн өмірі жасанды интеллектке тікелей байланысты. Келешекте оған сұраныстың артуы ғажап емес.

«Жасанды интеллект» сөзін алғаш рет 1956 жылы Дартмут университетінде өткен конференцияның преамбуласында Джон Маккарти қолданған. Маккартиге сәйкес «жасанды интеллектіні» зерттеушілер нақты проблеманы шешу үшін адамдарда байқалмайтын интеллектіні зерттеуіне болады. Сонымен қатар интеллект тек ғана биологиялық феномен деген де көзқарастар бар. Шындығында, жасанды интеллект Джон Маккартиге дейін де қолданылған. Тек оған дәл осы атау берілмеген. Мысалы, екінші дүниежүзілік соғыс кезінде Алан Тюринг есімді ағылшын математигі немістің құпия ақпаратын бұзып, оны шифрдан шығаратын машина құрастырады.

Алан Тьюринг соғыс кезінде Германияның әскери-теңіз флотының хабарламаларына криптоанализ жасайтын ағылшын үкіметінің Hut 8 атауына ие тобына жетекшілік еткен. Ол немістердің Энигма аппаратының кодын бұзып, мыңдаған адамның өмірін сақтап қалады. Соғыстан кейін ағылшын ғалымы алгоритмдік анализ жасаумен айналысып, 1950 жылы компьютер интеллектінің деңгейін анықтайтын тест әдісін жасап шығарады. Тьюринг тесті бүгінгі күнге дейін қолданылады.

Жасанды интеллект жеке ғылыми бағыт ретінде XX ғасырдың екінші жартысында пайда болды. Бұл көбінесе, кибернетиканың дамуына тәуелді еді. Басқару талдау, салыстыру, ақпаратты өңдеу, болжамды жасау, жорамалдың дұрыстығын дәлелдеу (яғни интеллектуалды қызметіне жататын операциялар) негізінде шешімді қабылдаумен байланысты болады.

Жасанды интеллект жүйелері – арнайы логикалық жүйелер арқылы компьютерлік бағдарламада жүзеге асырылған адам интеллектің жеке аспектісін ұдайы өндіретін техникалық жүйелер. Жасанды интеллект жүйелерінің қолдану салалары: роботтехника, сараптамалық жүйелер, есептерді әмбебап шешушіні жасау, бір тілден екінші тілге аудару, мәтінді рефераттау, пайдаланушыны компьютермен ыңғайлы диалогын қамтамасыз ететін интеллектуалды интерфейсты жасау.

Жұмыс орындарының қысқаруы және экономикалық теңсіздік

ЖИ мен робототехниканың дамуы көптеген салада адам еңбегін алмастыруға қабілетті. Әсіресе қайталанбалы және жоғары дәлдікті талап ететін жұмыстарға қатысты. Нәтижесінде жаппай жұмыссыздық және халықтың әлеуметтік жіктелуі артуы мүмкін. Технологиялық прогрестен пайда көретіндер мен оның салдарынан зардап шегетіндер арасындағы алшақтық кеңейіп, әлеуметтік шиеленістерге алып келуі ықтимал.

– Жасанды интеллекттің жаппай енгізілуі шын мәнінде еңбек нарығын қатты өзгертуде. Қарапайым, қайталанатын жұмыстарды ЖИ автоматтандырған сайын кейбір маман жұмыссыз қалуы мүмкін. Оның ішінде, біліктілігі төмен немесе цифрлық сауаттылығы нашар адамдар. Бұл өз кезегінде қоғамдағы әлеуметтік теңсіздікті күшейтеді – технологиямен жұмыс істей алатындар табысын еселейді. Басқалары шетке ығысып қалады. Дегенмен жаппай жұмыссыздық болмауы да мүмкін. Бірақ еңбек нарығы түбегейлі қайта құрылып жатыр. Оған бейімделу – мемлекеттің, білім беру жүйесінің және бизнестің ортақ міндеті, – дейді журналист, IT маман, «Жасанды интеллект әліппесі» кітабының авторы Мейіржан Әуелханұлы.

Автономиялық қару-жарақ жүйелері

ЖИ-ді әскери мақсаттарда, әсіресе адамның араласуынсыз шешім қабылдай алатын автономиялық қару-жарақ жүйелерін жасауда қолдану өте қауіпті. Мұндай жүйелердің қателіктері немесе басқарудан шығып кетуі жаппай қырып-жою қаруының жаңа түріне айналып, адамзат үшін орны толмас салдарға әкелуі мүмкін. Халықаралық деңгейде мұндай қаруды жасауға және қолдануға тыйым салу туралы талқылаулар жүріп жатыр, бірақ консенсусқа жету қиынға соғуда.

– ЖИ-дің әскери салада қолданылуы – ең алаңдатарлық мәселелердің бірі. Автономды қару жүйелері, яғни өз бетімен нысана таңдап, шабуылдай алатын ЖИ, адам шешімін айналып өтіп, қателік жібереріне ешкім кепіл бере алмайды. Мұндай жүйелерге моральдық, құқықтық жауапкершілік жүктеу қиын. Мәселен, бейбіт тұрғындар қателесіп атылса, кім кінәлі болады? Одан бөлек ЖИ көмегімен кибершабуылдар, жалған ақпарат тарату, ақпараттық соғыстар да қарқынды жүруде. Сондықтан бұл салада халықаралық келісімдер мен бақылау механизмдері қажет, – дейді IT маман Мейіржан Әуелханұлы.

Құпиялылық және бақылау

ЖИ үлкен деректер көлемін өңдеуге қабілетті, бұл жеке өмірге қол сұғу және толық бақылау мүмкіндігін тудырады. Адамдардың іс-әрекеттері, қалаулары және тіпті ойлары туралы деректерді жинау және талдау диктаторлық режимдер үшін қуатты құралға айналуы мүмкін. Бұл жағдайда азаматтық бостандықтар мен демократиялық құндылықтарға қауіп төнеді.

«Жасанды интеллект әліппесі» кітабының авторы Мейіржан Әуелханұлы: «ЖИ дамыған сайын адамдардың ізденуден, ойлаудан қалу қаупі де бар. Әсіресе жастар дайын жауапқа үйреніп, терең ойлануға тырыспай қоюы мүмкін. Егер біз бәрін ЖИ-ге сеніп тапсырып, өзімізді тек тұтынушы деңгейінде қалдырсақ, логикалық ойлау, сыни талдау қабілеттеріміз әлсірейді. Бұл – тек технология мәселесі емес, мәдениет пен білім беру мәселесі де. Сондықтан ЖИ-ді көмекші құрал ретінде пайдаланып, бірақ адам ойы мен шығармашылығын алдыңғы орынға қою ең дұрыс жол» деген ойын жеткізді.

ЖИ-дің этикалық мәселелері

ЖИ жүйелері олар оқытылған деректердегі біржақтылықты (смещение) қайталай алады. Егер деректерде нәсілдік, гендерлік немесе басқа да кемсітушіліктер болса, ЖИ осы біржақтылықтарды автоматты түрде қайталап, тіпті күшейтуі мүмкін. Бұл әлеуметтік әділетсіздіктің одан әрі артуына және белгілі бір топтарға қатысты кемсітушілік шешімдердің қабылдануына алып келеді. Мысалы, ЖИ несие беру, жұмысқа қабылдау немесе тіпті қылмыстық істер бойынша шешім қабылдаған кезде әділетсіздікке жол беруі мүмкін.

ЖИ-дің адамзатқа қауіп төндіруі: Сингулярлық және бақылауды жоғалту ең үлкен, бірақ әлі де теориялық қауіп – сингулярлық деп аталатын жағдай. Бұл ЖИ адам интеллектінен асып түсіп, өзін-өзі жетілдіре бастайтын нүкте. Егер мұндай ЖИ адамзаттың құндылықтары мен мақсаттарына сәйкес келмесе, ол адамзатты бақылаудан шығып, тіпті оған қауіп төндіруі мүмкін. Бұл сценарий ғылыми фантастикалық болып көрінері сөзсіз. Бірақ көптеген сарапшы оның ықтималдығын жоққа шығармайды.

Болашаққа бағыт

Жасанды интеллекттің потенциалды қауіптерін азайту үшін кешенді тәсіл қажет деп дабыл қағуда мамандар. Яғни халықаралық ынтымақтастық: ЖИ-ді дамыту мен реттеуде халықаралық келісімдер мен нормаларды әзірлеу маңызды екен.

Этикалық қағидаттар бойынша ЖИ-ді әзірлеу және қолдану кезінде қатаң этикалық нормаларды сақтау керек. ЖИ жүйелерінің әділ, ашық және жауапты болуын қамтамасыз ету де маңызды.

Ал Мейіржан Әуелханұлының пайымынша, ЖИ-дің қауіптерін азайтуға айрықша мән берілуі тиіс. Мұнда техникалық, құқықтық және этикалық бағыттарды үйлестіріп қарастырылған жөн. Мысалы, қауіпсіздікке баса мән беретін «AI alignment» зерттеулері жүріп жатыр. Нақты айтқанда, ЖИ-дің әрекеттері адам мүддесіне сай болуын қамтамасыз ету. Сонымен бірге ашықтық, аудит, бақылай алатын механизмдер, адам шешімін айналып өтпеу секілді қағидаларға назар аударған дұрыс. Көптеген ел мен компаниялар «жауапты ЖИ» (responsible AI) тұжырымдамасын енгізуде.

Қауіпсіздік пен қадағалау

ЖИ жүйелерінің қауіпсіздігін арттыру және олардың бақылаудан шығып кетуіне жол бермеу үшін тиісті шаралар қабылдануы тиіс.

Білім және дағдыларды жаңарту: Жұмыссыздықтың алдын алу үшін білім беру жүйелерін жаңарту, жаңа дағдыларды үйрету және адамдарды ЖИ дәуіріндегі жұмыс орындарына дайындау қажет.

Қоғамдық талқылауда ЖИ-дің болашағы туралы ашық және кең қоғамдық талқылауды ынталандыру керек. Бұл халықтың алаңдаушылығын ескеруге және тиімді шешімдер қабылдауға көмектеседі.

Жасанды интеллект дамыған сайын адам ізденуден, ойланудан алыстап кетпеуі үшін, ең алдымен, білім беру жүйесін түбегейлі өзгерту қажет. Қазіргі мектептер мен университеттер тек ақпаратты меңгеруге емес, сол ақпаратты сараптауға, талдауға, пікір қалыптастыруға үйретуі керек. Мысалы, оқушы ЖИ-дің берген жауабын жаттап қана қоймай, оны сынап, баламалы көзқарас ұсына алуы тиіс. Бұл үшін логикалық ойлау, сыни талдау, философиялық пайым сияқты дағдылар жүйелі түрде үйретілуі керек.

Сонымен қатар жастарға ЖИ-ді тек тұтынушы ретінде емес, оны құрастыра алатын адам ретінде қарауға мүмкіндік берген жөн. Бұл мақсатта интерактивті үйірмелер, креативті жобалар, хакатондар ұйымдастырылса, балалар ЖИ-ді құрал ретінде игереді де, оған тәуелді болмайды. Мысалы, «ЖИ-мен пікірталас» сияқты ойын форматындағы жобалар олардың ойлау қабілетін дамытып, дайын жауапқа үйреніп қалуына жол бермейді.

– Жалпы қоғамда да ЖИ-ге деген сауатты көзқарас қалыптастыру маңызды. ЖИ не істей алады, не істей алмайды, оның шектеулері мен қауіптері қандай? Осының бәрін қарапайым, түсінікті тілмен жастарға жеткізу керек. Әлеуметтік желілер мен медиа кеңістігінде адамның өз идеясы мен шығармашылығын жоғары қоятын қоғамдық жобалар көбірек болуы қажет. «Адам мен ЖИ жарысы», «Шынайы сезім мен алгоритм» секілді мәдени форматтар арқылы адам баласының ойы мен жүрегінің құндылығын ұмыттырмауымыз керек, – дейді М.Әуелханұлы.

Мемлекет те шет қалмауы тиіс. Білім беру бағдарламаларына ЖИ-ге қатысты этика, қауіпсіздік және жауапты қолдану мәдениеті туралы пәндер енгізу қажет. Бұл болашақта ЖИ-мен бірге өмір сүретін ұрпақтың адами қасиетін жоғалтпай, технологияны саналы түрде басқаруына жол ашады. ЖИ мидың орнына емес, қасындағы серіктес ретінде қабылдануы үшін, біз баланың жастайынан өз ойына сенуіне жағдай жасауымыз керек. Сонда ғана болашақ ұрпақ дайын жауапты емес, дұрыс сұрақ қоюдың, шынайы ізденістің, адам болудың мәнін ұмытпайды.

Қорытындылай келе, жасанды интеллект адамзат тарихындағы ең маңызды технологиялық жетістіктердің бірі болып, елеулі мүмкіндіктермен қатар маңызды қауіптерді де алып келеді. Бұл қауіптерді мойындап, оларға дайындалу және оларды басқару үшін белсенді шаралар қабылдау уақыт талабы. ЖИ-дің болашағы біздің оны қалай дамытатынымызға және басқаратынымызға байланысты.

Жасанды интеллекттің адамзатқа төнген қаупі – бұл фантастикалық фильмнің сценарийі ғана емес, шұғыл назар аударуды қажет ететін нақты және күрделі мәселе. AI қарғыс емес, батаға айналуын қамтамасыз ету халықаралық ынтымақтастықты, терең ғылыми зерттеулерді, мұқият реттеуді және кең қоғамдық пікірталастарды қажет етеді. Тек бірлесіп жұмыс істеу арқылы адамзат экзистенциалды тәуекелдерді азайтып, қауіпсіз және гүлденген болашақты қамтамасыз ете отырып, AI әлеуетін пайдалана алады.

Айнұр ҚАЗМАҒАМБЕТОВА